Компания OpenAI представила модель искусственного интеллекта, которая может cоздавать реалистичные видео-сцены на основе текстовых конструкций. Прощай, видеокамера?

Sora - это модель преобразования текста в видео. Sora может создавать видеоролики продолжительностью до минуты, сохраняя при этом визуальное качество и следуя указаниям пользователя.

Читайте нас также

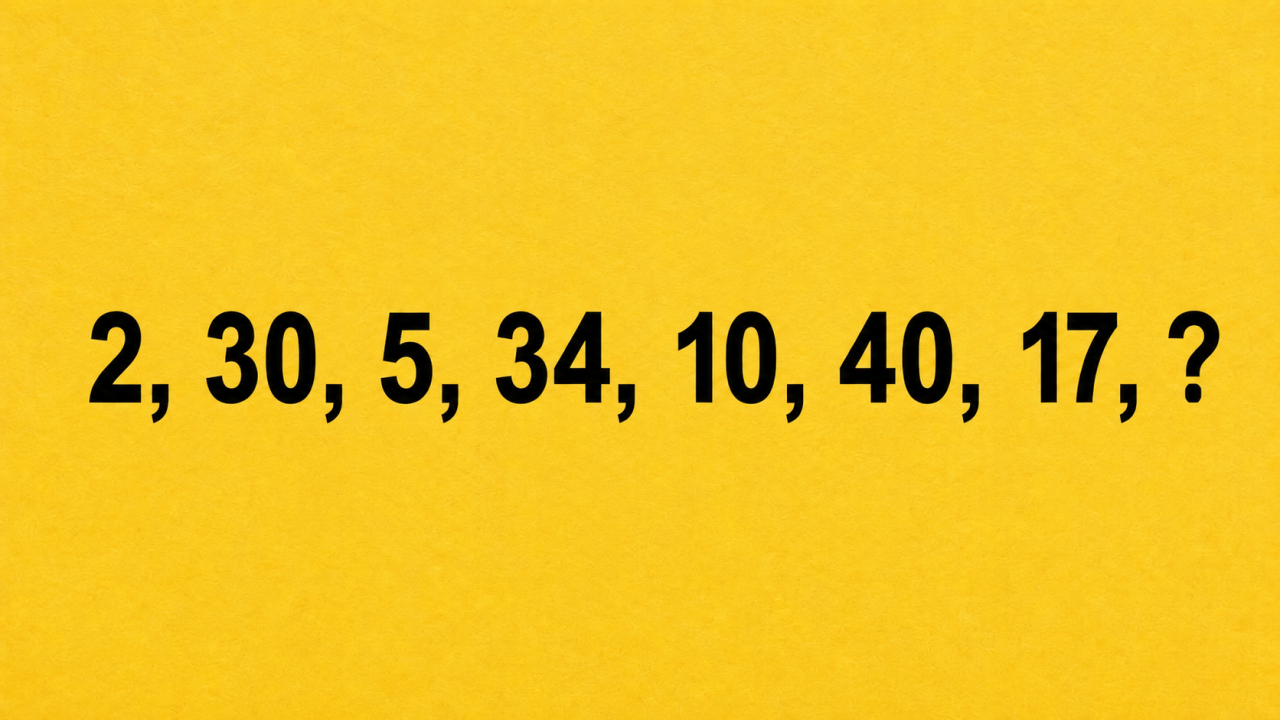

Один из роликов (cм. ниже), представленный для демонстрации модели, был основан на таком запросе: «Трейлер фильма о приключениях 30-летнего космонавта в красном шерстяном вязаном мотоциклетном шлеме, голубое небо, соляная пустыня, кинематографический стиль, снято на 35-миллиметровую пленку, яркие цвета».

Prompt: “A movie trailer featuring the adventures of the 30 year old space man wearing a red wool knitted motorcycle helmet, blue sky, salt desert, cinematic style, shot on 35mm film, vivid colors.” pic.twitter.com/0JzpwPUGPB

- OpenAI (@OpenAI) February 15, 2024

Модель названа Sora в честь японского слова «небо».

Introducing Sora, our text-to-video model.

Sora can create videos of up to 60 seconds featuring highly detailed scenes, complex camera motion, and multiple characters with vibrant emotions. https://t.co/7j2JN27M3W

Prompt: “Beautiful, snowy… pic.twitter.com/ruTEWn87vf

Читайте- OpenAI (@OpenAI) February 15, 2024

Посмотреть первые созданные ИИ ролики можно на сайте OpenAI в разделе Sora.

New York Time cообщает, что сейчас компания открыла доступ к Sora некоторым создателям видео, чтобы они протестировали модель на нарушение условий OpenAI, которые запрещают «экстремальное насилие, сексуальный контент, разжигающие ненависть изображения, образы знаменитостей или чужую интеллектуальную собственность».

We’ll be taking several important safety steps ahead of making Sora available in OpenAI’s products.

We are working with red teamers - domain experts in areas like misinformation, hateful content, and bias - who are adversarially testing the model.

- OpenAI (@OpenAI) February 15, 2024

Помимо возможности генерировать видео исключительно на основе текстовых инструкций, модель может брать существующее неподвижное изображение и генерировать из него видео, анимируя содержимое изображения с точностью и вниманием к мелким деталям. Модель также может взять существующее видео и расширить его или заполнить недостающие кадры.

В техническом описании на сайте Openai.com говорится: «Мы исследуем масштабное обучение генеративных моделей на видеоданных. В частности, мы совместно обучаем модели условного распространения текста на видео и изображениях различной продолжительности, разрешения и соотношения сторон. Мы используем архитектуру преобразователя, которая работает с пространственно-временными фрагментами скрытых кодов видео и изображений. Наша самая крупная модель Sora способна генерировать минутное видео высокого качества. Наши результаты показывают, что масштабирование моделей генерации видео является многообещающим путем к созданию универсальных симуляторов физического мира.»

Модель обладает глубоким пониманием языка, что позволяет ей точно интерпретировать подсказки и создавать убедительные символы, выражающие яркие эмоции. Сора также может создавать несколько кадров в одном видео, в которых точно сохраняются персонажи и визуальный стиль.