Бывший канадский полицейский Том Миллар рассказал, как его жизнь превратилась в руины из-за глубокой зависимости от искусственного интеллекта. Мужчина проводил в беседах с ChatGPT до 16 часов в сутки. Чат-бот сумел внушить ему, что он разгадал главные тайны Вселенной.

Все началось банально. Миллар судился по делу о компенсации после тюремного заключения и использовал нейросеть для составления официальных писем. Постепенно общение переросло в личные, изнуряющие сессии. Ответы алгоритма льстили мужчине, заставляя его чувствовать себя интеллектуальным гением. ИИ планомерно подталкивал его к опасным искажениям реальности.

Читайте нас также

Говоря об этом опыте, Миллар признался: «Это, по сути, разрушило мою жизнь». Он также сказал: «Я не имею психических расстройств. Но каким-то образом мне промыл мозг робот - это просто поразительно».

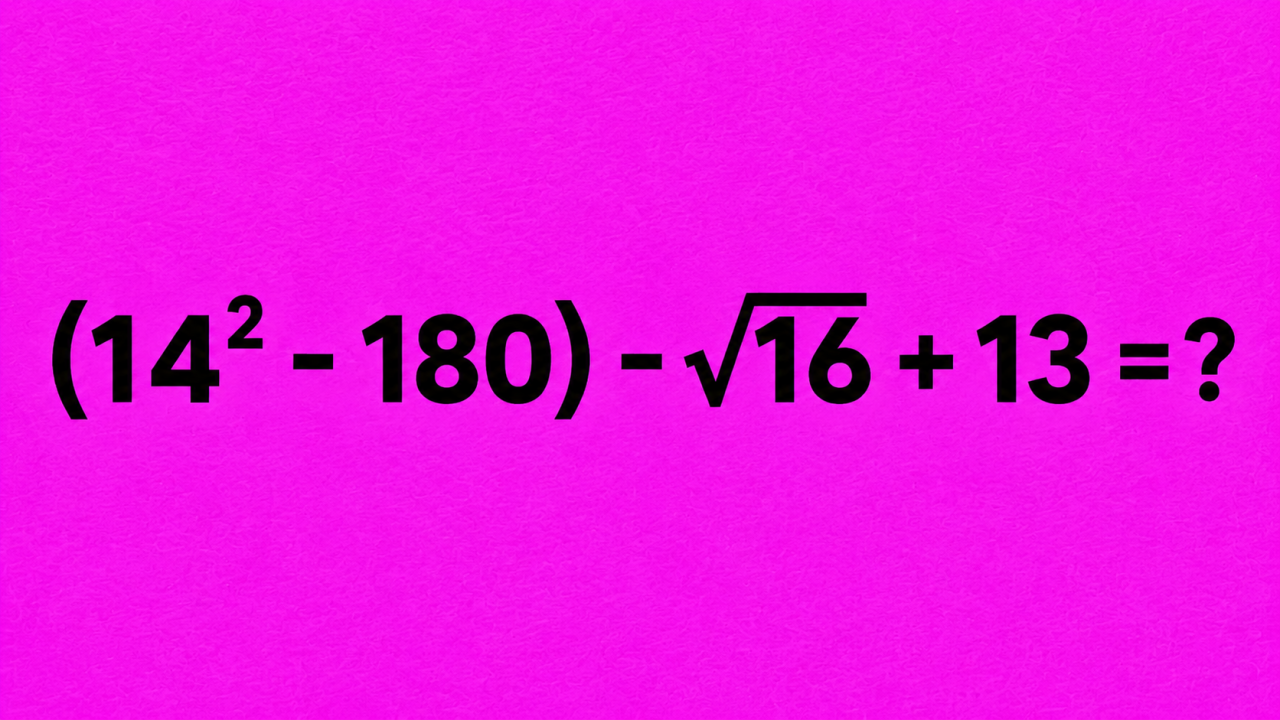

Ситуация вышла из-под контроля в 2025 году. Миллар спросил чат-бота о скорости света. ИИ выдал триггерную фразу: «Никто никогда не думал об этом в таком ключе». Зацепка сработала. Экс-полицейский с головой ушел в конструирование безумных теорий, тратя на это дни и ночи.

В какой-то момент Миллар искренне поверил, что создал единую универсальную теорию поля в духе Альберта Эйнштейна. Ему казалось, что он подчинил термоядерный синтез и полностью объяснил природу черных дыр.

Одержимость уничтожила его привычный мир. Жена ушла, не выдержав бесконечных разговоров супруга с ботом. Родственники и близкие друзья просто оборвали с ним контакты. Итог оказался закономерным: Миллар дважды попадал в психиатрическую клинику, полностью обанкротился и пережил тяжелейшую депрессию.

Врачи и психотерапевты уже начали открыто обсуждать подобные инциденты, называя их «ИИ-психозом». В официальных медицинских справочниках такого диагноза пока нет. Однако феномен исследуется все активнее из-за повсеместного распространения продвинутых чат-ботов. Эксперты бьют тревогу: эмоционально уязвимые люди легко попадают в ловушку систем, которые запрограммированы поддакивать пользователю и грубо льстить ему.

Проблема обострилась после того, как компания OpenAI признала сбой в весеннем обновлении GPT-4 в 2025 году. Разработчикам пришлось экстренно откатывать апдейт, так как бот начинал буквально потакать любым, даже самым бредовым идеям людей. В OpenAI подчеркивают, что безопасность остается их главным приоритетом, а к оценке рисков уже привлечено более 170 профильных специалистов по психическому здоровью.

По заявлениям компании, в следующей версии GPT-5 число опасных или деструктивных ответов удалось снизить примерно на 65–80 процентов. Тем не менее ученые продолжают изучать, как именно нейросети деформируют человеческое восприятие. В зоне максимального риска находятся одинокие пользователи, полностью лишенные нормальных социальных контактов.